أخلاقيات الذكاء الاصطناعي أصبحت تقنيات الذكاء الاصطناعي (AI) ظاهرة ثقافية تعد بتغيير طريقة الاعمال بشكل جذري. ولكن كالعادة عندما تظهر أي ابتكارات تكنولوجية جديدة ، يميل المجتمع إلى التشويش عليها او حتي مهاجمتها. ولكن الحقيقة لم يكن لدينا تقنية بهذه القوة علي الإطلاق.

ما هي أخلاقيات الذكاء الاصطناعي؟

تشير أخلاقيات الذكاء الاصطناعي إلى المبادئ التوجيهية التي تحكم التطوير لتقنيات الذكاء الاصطناعي ونشرها واستخدامها. بالإضافة إلى ذلك، أدوات الذكاء الاصطناعي: يجب على أقسام الموارد البشرية استخدامها

ويتضمن ذلك ضمان توافق أنظمة وتطبيقات الذكاء الاصطناعي مع المعايير الأخلاقية والقيم الإنسانية واللوائح القانونية.

كما يركز الجانب الأخلاقي لتقنيات الذكاء الاصطناعي علي الاعتبارات والمبادئ الأخلاقية التي تحكم تطوير ونشر واستخدام أنظمة الذكاء الاصطناعي (AI). علي جانب اخر، ثورة الذكاء الاصطناعي في عالم صناعة السياحة واللغات

وهي تنطوي على ضمان التزام تقنيات الذكاء الاصطناعي بالمعايير الأخلاقية ، وتجنب التحيز، وحماية الخصوصية، ودعم حقوق الإنسان من خلال تعزيز ممارسات الذكاء الاصطناعي المسؤولة والخاضعة للمساءلة.

الهدف من أخلاقيات الذكاء الاصطناعي هو معالجة المخاطر والتحديات المحتملة المرتبطة بالذكاء الاصطناعي، وتعزيز الشفافية والعدالة، وتجنب أي عواقب سلبية قد تنشأ عن عملية صنع القرار في الذكاء الاصطناعي. علاوة على ذلك، كيف يؤثر الذكاء الاصطناعي على العمل؟

الجوانب الرئيسية لأخلاقيات الذكاء الاصطناعي ما يلي:

الشفافية: التأكد من أن أنظمة الذكاء الاصطناعي شفافة وقابلة للشرح والتفسير، مما يسمح للمستخدمين بفهم كيفية اتخاذ القرارات.

العدالة: التخفيف من التحيزات في خوارزميات الذكاء الاصطناعي لمنع التمييز وضمان المعاملة العادلة لجميع الأشخاص.

المساءلة: تحميل الأفراد والمنظمات المسؤولية عن تطوير أنظمة الذكاء الاصطناعي ونشرها ونتائجها.

الخصوصية: احترام حقوق خصوصية الأفراد وحماية المعلومات الحساسة عند جمع البيانات ومعالجتها.

الأمان: تنفيذ تدابير لتأمين أنظمة الذكاء الاصطناعي ضد الهجمات الضارة والوصول غير المصرح به.

التعاون: تشجيع التعاون بين المطورين وصانعي السياسات وعلماء الأخلاق وغيرهم من أصحاب المصلحة لوضع معايير عالمية وأفضل الممارسات.

الاستدامة: النظر في التأثير البيئي لتقنيات الذكاء الاصطناعي وتعزيز الممارسات المستدامة في تطويرها واستخدامها.

تسعى أخلاقيات الذكاء الاصطناعي إلى تحقيق التوازن بين تقدم الابتكار التكنولوجي والتأكد من أن الذكاء الاصطناعي يفيد المجتمع دون المساس بالقيم الإنسانية الأساسية أو التسبب في أي ضرر.

ويساعد إنشاء أسس وقواعد أخلاقية في توجيه عملية التطوير والتطبيق للذكاء الاصطناعي في مختلف المجالات، مما يعزز الثقة ويقلل من العواقب غير المقصودة. وفي الوقت نفسه، كيف يغير الذكاء الاصطناعي عملية التوظيف؟

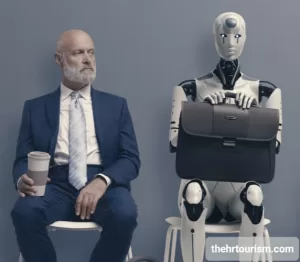

دور الذكاء الاصطناعي في الموارد البشرية

في المشهد الديناميكي للموارد البشرية، فإن التآزر بين الذكاء الاصطناعي (AI) ومتخصصي الموارد البشرية يعيد تشكيل هذة الصناعة.

في حين أن الذكاء الاصطناعي لا يمكنه أن يحل محل اللمسة البشرية والإنسانية التي تحدد طبيعة الموارد البشرية التي تركز على الأفراد، فإن إمكاناته التحويلية لا لبس فيها.

من تسريع عمليات التوظيف وتحسين اختيار الموظفين إلى تخصيص المهام والتحليلات، يُحدث الذكاء الاصطناعي ثورة في ممارسات الموارد البشرية.

ووفقا لدراسة استقصائية لموقع Eightfold Ai حول مستقبل العمل، أشارت على الاستخدام الواسع النطاق للذكاء الاصطناعي في مختلف وظائف الموارد البشرية.

بما في ذلك إدارة شؤون الموظفين، ومعالجة كشوف المرتبات، والتوظيف، وإدارة الأداء ، والتأهيل.

إن آثار الذكاء الاصطناعي على عمليات الموارد البشرية بعيدة المدى، مما يساهم في خلق مشهد أكثر سلاسة وكفاءة للموارد البشرية. وفي نفس السياق، مستقبل الذكاء الاصطناعي في الموارد البشرية إمكانيات لا حصر لها

مع قيام مسؤولي الموارد البشرية بتبني أدوات الذكاء الاصطناعي لتعزيز تجربة الموظف، فإن إجراء فحص شامل للأبعاد الأخلاقية أمر بالغ الأهمية.

يتعمق هذا الاستكشاف في التكامل المسؤول والمدروس للذكاء الاصطناعي في ممارسات الموارد البشرية، مما يضمن التوازن بين الابتكار والاعتبارات الأخلاقية.

كيف يتم استخدام الذكاء الاصطناعي حاليًا في الموارد البشرية؟

يمكن للذكاء الاصطناعي العادل والأخلاقي أن يمكّن متخصصي الموارد البشرية من إحداث تأثير أكبر للموظفين. فقط تأكد من مراعاة جميع العوامل المؤثرة وممارسة السلطة التقديرية وضبط النفس عند استخدام أي تقنية جديدة.

ضع خطة لكيفية استخدامك أنت وفريق التكنولوجيا بشكل مناسب لتحسين تجربة الموظف ونتائج الأعمال. خارج هذا السياق، حل المشكلات المهنية: ٧ مهارات لحل المشاكل في العمل

من المتوقع أن يتوسع استخدام الذكاء الاصطناعي في تقنيات الموارد البشرية بسرعة كبيرة، وسيكون لدينا الكثير لنتعلمه حول كيفية الاستفادة من هذه القدرات بشكل أفضل في الأشهر والسنوات القادمة.

لكننا نشهد بالفعل بعض حالات الاستخدام التي تعطينا نظرة خاطفة على ما هو سوف يكون في مجال الموارد البشرية وخارجها.

لقد شهد اكتساب المواهب أكبر طفرة في حلول الذكاء الاصطناعي حتى الآن، مع وجود أدوات لتحديد مصادر المرشحين، ومراجعة السير الذاتية، وحتى إجراء المقابلات.

يستخدم العديد من الشركات والمؤسسات روبوتات الدردشة بالذكاء الاصطناعي مثل ChatGPT للقيام بمهام تكتيكية مختلفة.

وقد يستخدمونها للتفكير بشكل تعاوني، أو المشاركة في لعب الأدوار القائمة على السيناريوهات، أو إنشاء محتوى وأسئلة، أو تعزيز جلسات العصف الذهني.

ما هي الآثار الأخلاقية للذكاء الاصطناعي في الموارد البشرية؟

يقدم تكامل الذكاء الاصطناعي (AI) مع الموارد البشرية العديد من الفرص والتحديات. بينما يتبنى قادة الموارد البشرية الذكاء الاصطناعي لتعزيز الوظائف المختلفة، فإن الاعتبارات الأخلاقية تحتل مركز الصدارة.

يتعمق هذا القسم في الآثار الأخلاقية للذكاء الاصطناعي في الموارد البشرية ، ويستكشف كيف يمكن للمؤسسات التنقل في هذا المشهد المتطور بمسؤولية مع ضمان الشفافية والعدالة والنزاهة.

1. تحقيق العدالة وعدم التحيز

يعد إجراء تحقيق العدالة وعدم المساواة خطوة بالغة الأهمية في ضمان الآثار الأخلاقية للذكاء الاصطناعي في الموارد البشرية.

تتضمن هذه العملية فحصًا شاملاً لأنظمة الذكاء الاصطناعي لتحديد وتصحيح أي تحيزات أو ظلم محتمل.

وهو ينطوي على مراجعة دقيقة لبيانات التدريب والتطوير، والتدقيق في عملية التوظيف، وتقييم النتائج الناتجة عن الذكاء الاصطناعي، ومراقبة فعالية النظام عن قرب.

ولتنفيذ هذا التقييم بفعالية، يجب على المؤسسات إنشاء فريق متعدد الوظائف من المسؤولين عن توجيه أخلاقيات الذكاء الاصطناعي.

تلعب هذه المجموعة التعاونية، والتي قد تضم ممثلين عن أقسام الموارد البشرية وتكنولوجيا المعلومات والشؤون القانونية وغيرها من الإدارات ذات الصلة، دورًا محوريًا في دعم المعايير الأخلاقية والإشراف على استخدام الذكاء الاصطناعي والتعامل بشكل سريع مع أي مخاوف أخلاقية قد تنشأ.

لا يضمن تقييم التحيز والعدالة القوي ممارسات الذكاء الاصطناعي الأخلاقية فحسب، بل يعزز أيضًا الشفافية والعدالة في عمليات الموارد البشرية.

2. تجنب انتهاك خصوصية الموظف

قد تنشأ مخاوف تتعلق بالخصوصية عند تنفيذ أدوات الذكاء الاصطناعي التي تقوم بجمع البيانات الشخصية وتخزينها وتحليلها.

من الضروري التأكد من أن المرشحين والموظفين على علم تام بكيفية وسبب التعامل مع معلوماتهم وتخزينها وحمايتها من الوصول غير المصرح به.

يعد إعطاء الأولوية للخصوصية والأمن أمرًا بالغ الأهمية في اعتماد الذكاء الاصطناعي في مكان العمل .

في حين أن بعض أنظمة الذكاء الاصطناعي مصممة لتجاهل معلومات المستخدم أو الامتناع عن إعادة استخدامها، فإن أنظمة أخرى قد تستخدم البيانات (مثل الأوامر الصوتية، وتفاصيل الجنس، وتعديلات اللغة، وما إلى ذلك) لتدريب خوارزميات التعلم الآلي.

وهذا يقدم مخاطر محتملة على خصوصية الموظفين أو العملاء عموما. ولذلك، فإن أي بيانات تتعلق بالموظفين أو العملاء أو الجوانب السرية للمؤسسة يجب أن تخضع لإخفاء الهوية قبل استخدامها في تطبيقات الذكاء الاصطناعي.

3. ضمان الشفافية والوضوح

تعد الشفافية والوضوح من الاعتبارات الأخلاقية الأساسية في استخدام الذكاء الاصطناعي في الموارد البشرية.

يجب على قادة الأعمال إعطاء الأولوية للانفتاح، خاصة عندما يتم استخدام الذكاء الاصطناعي لمراقبة الأفراد أو اتخاذ القرارات التي تؤثر عليهم بشكل مباشر.

في الحالات التي يكون فيها نظام الذكاء الاصطناعي مسؤولاً عن اتخاذ القرار فيما يتعلق بالموظفين، يجب على متخصصي الموارد البشرية تقديم تفسيرات واضحة فيما يتعلق بالعوامل التي يتم أخذها في الاعتبار في عملية صنع القرار .

يعزز هذا الالتزام بالشفافية الثقة والمساءلة في استخدام الذكاء الاصطناعي ضمن ممارسات الموارد البشرية.

4. ضمان السيطرة البشرية

يعد ضمان السيطرة البشرية مبدأ أخلاقيًا أساسيًا في نشر الذكاء الاصطناعي (AI) في الموارد البشرية.

في حين أن الذكاء الاصطناعي يمكن أن يعزز الكفاءة وصنع القرار، فإن الحفاظ على التوازن مع الرقابة البشرية أمر بالغ الأهمية.

تضمن السيطرة البشرية توافق أنظمة الذكاء الاصطناعي مع المعايير الأخلاقية، مما يعزز العدالة ويمنع العواقب غير المقصودة.

يجب أن يحتفظ متخصصو الموارد البشرية بسلطة التدخل وتفسير وتصحيح النتائج الناتجة عن الذكاء الاصطناعي.

ويحمي هذا النهج الذي يركز على الإنسان من التأثير غير المبرر للذكاء الاصطناعي، ويعزز بيئة مكان العمل حيث تعمل التكنولوجيا كأداة داعمة تحت التوجيه البشري.

علاوة على ذلك، تعمل السيطرة البشرية بمثابة ضمانة ضد التحيزات المحتملة المضمنة في خوارزميات الذكاء الاصطناعي.

وبينما تتعلم أنظمة الذكاء الاصطناعي من البيانات التاريخية، فإنها قد تؤدي عن غير قصد إلى إدامة التحيزات القائمة. يصبح التدخل البشري ضروريًا لتحديد وتصحيح ومنع أي أنماط تمييزية قد تظهر.

يلعب متخصصو الموارد البشرية، بخبرتهم في فهم الديناميكيات التنظيمية واحتياجات القوى العاملة المتنوعة، دورًا حاسمًا في تخفيف التحيز وضمان توافق الذكاء الاصطناعي مع التزام الشركة بالعدالة والشمولية.

ومن خلال دعم السيطرة البشرية، لا تلتزم المؤسسات بالممارسات الأخلاقية للذكاء الاصطناعي فحسب، بل تعمل أيضًا على تعزيز ثقافة الشفافية والمساءلة.

5. بناء نظام ذكاء اصطناعي يتمحور حول الإنسان

من خلال إعطاء الأولوية لنهج يركز على الإنسان، تعترف المنظمات بأهمية الحفاظ على رفاهية وكرامة وحقوق الأفراد المعنيين.

إن تصميم أنظمة الذكاء الاصطناعي التي تعطي الأولوية للتجربة الإنسانية يضمن نتائج عادلة وغير متحيزة، ويعزز الشمولية ويخفف الضرر المحتمل.

يركز نظام الذكاء الاصطناعي الذي يتمحور حول الإنسان على عوامل مثل المساواة والتنوع وحماية الخصوصية.

وهي تسعى جاهدة إلى تعزيز عملية صنع القرار البشري بدلاً من استبدالها، وتعزيز التعاون بين تكنولوجيا الذكاء الاصطناعي والحدس البشري.

ومن خلال إشراك الموظفين بشكل فعال في عمليات التطوير والتنفيذ، يمكن للمؤسسات إنشاء نظام يتوافق مع قيمها ومعاييرها الأخلاقية.

في جوهره، يسعى نظام الذكاء الاصطناعي الذي يتمحور حول الإنسان إلى تعزيز القدرات البشرية، ودعم اتخاذ القرارات الأخلاقية، ودعم مبادئ العدالة والاحترام في مجال الموارد البشرية.

إنه بمثابة أساس لبناء الثقة وتعزيز تجارب الموظفين الإيجابية والتغلب على التعقيدات الأخلاقية المرتبطة بدمج الذكاء الاصطناعي في ممارسات الموارد البشرية.

أسألة شائعة حول أخلاقيات الذكاء الاصطناعي

ما الأهمية بالنسبة للشركات؟

تعتبر أخلاقيات الذكاء الاصطناعي مهمة للشركات بشكل كبير لضمان الاستخدام المسؤول والأخلاقي للذكاء الاصطناعي.

يساعد الالتزام بالمبادئ الأخلاقية على منع التحيز، وحماية الخصوصية، وتعزيز الشفافية، وضمان نتائج عادلة، وتعزيز الثقة بين أصحاب المصلحة وتخفيف المخاطر القانونية والاجتماعية والمخاطر المتعلقة بالسمعة.

كيف يؤثر الذكاء الاصطناعي على قيادة الموارد البشرية؟

يؤثر الذكاء الاصطناعي على قيادة الموارد البشرية من خلال إتمام المهام الروتينية، وتمكين اتخاذ القرارات المعتمدة علي البيانات، وتعزيز الكفاءة في عمليات الموارد البشرية.

فهو يساعد قادة الموارد البشرية في اكتساب المواهب، وإشراك الموظفين، وتخطيط القوى العاملة، مما يسمح لهم بالتركيز بشكل أكبر على المبادرات الإستراتيجية، وتطوير الموظفين، وتعزيز ثقافة إيجابية في مكان العمل.

الملخص

يوفر التقدم السريع للذكاء الاصطناعي (AI) في مجال الموارد البشرية العديد من الفرص، ومع ذلك، فإن هذا التطور السريع يثير أيضًا مخاوف أخلاقية بالغة الأهمية في ممارسات الموارد البشرية.

أصبح الالتزام بأخلاقيات الذكاء الاصطناعي وضمان اتخاذ تدابير قوية لخصوصية البيانات أمرًا ضروريًا في التغلب على هذه المخاطر الأخلاقية المحتملة داخل عمليات الموارد البشرية.

المصدر: ai ethics human resource leaders